За останні кілька років штучний інтелект (ШІ) розвивався із вражаючою швидкістю. Деякі вчені зараз дивляться на розробку штучного суперінтелекту (ASI) – форми штучного інтелекту, яка не тільки перевершила б людський інтелект, але й не була б обмежена швидкістю навчання людини.

Але що, якщо ця віха — не просто видатне досягнення? Що, якщо воно також є грізним вузьким місцем у розвитку всіх цивілізацій, таким складним, що перешкоджає їх довгостроковому виживанню?

Відповідь на це питання дає Майкл Ґарретт, автор статті на сайті The Conversation.

ШІ як великий фільтр Всесвіту

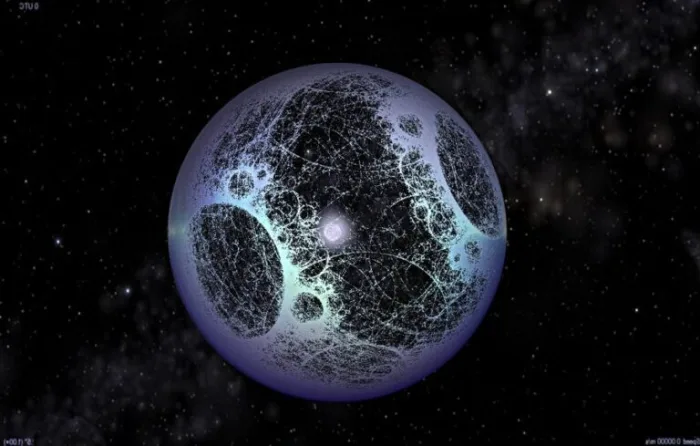

Чи може штучний інтелект бути «великим фільтром» Всесвіту – порогом, який настільки важко подолати, що він заважає більшій частині життя еволюціонувати в цивілізації, що літають у космос?

Це концепція, яка може пояснити, чому пошуки позаземного розуму (Seti) ще не виявили слідів передових технічних цивілізацій в інших місцях галактики.

Гіпотеза великого фільтра є, зрештою, запропонованим рішенням парадоксу Фермі. Це ставить під сумнів, чому у Всесвіті, великому та досить стародавньому, щоб вмістити мільярди потенційно придатних для життя планет, ми не виявили жодних ознак інопланетних цивілізацій.

Гіпотеза припускає, що в еволюційній шкалі цивілізацій існують нездоланні перешкоди, які заважають їм розвиватися в космічні спільноти.

Поява штучного суперінтелекту (ASI) може стати таким фільтром. Швидкий розвиток ШІ, який потенційно може призвести до ASI, може перетинатися з критичною фазою розвитку цивілізації – переходом від однопланетного виду до багатопланетного.

Саме тут багато цивілізацій можуть похитнутися, оскільки штучний інтелект розвивається набагато швидше, ніж наша здатність контролювати його чи стабільно досліджувати та заселяти нашу Сонячну систему.

Проблема з ШІ, зокрема з ASI, полягає в його автономному, самопосилюючому та покращуючому характері. Він має потенціал для розширення власних можливостей зі швидкістю, яка випереджає наші власні еволюційні часові рамки без ШІ.

Потенціал того, що щось піде не так, величезний, що призведе до падіння як біологічних, так і штучного інтелекту, перш ніж вони отримають шанс стати мультипланетними.

Наприклад, якщо країни будуть все більше покладатися на автономні системи штучного інтелекту, які конкурують одна з одною, і віддавати їм повноваження, військовий потенціал може бути використаний для вбивства та знищення в безпрецедентних масштабах. Це потенційно може призвести до знищення всієї нашої цивілізації, включаючи самі системи ШІ.

За цим сценарієм типове довголіття технологічної цивілізації може становити менше 100 років. Приблизно стільки часу пройшло між можливістю прийому та трансляції сигналів між зірками (1960 рік) і передбачуваною появою ASI (2040 рік) на Землі. Це тривожно мало, якщо порівняти його з космічним масштабом у мільярди років.

Ця оцінка, підключена до оптимістичних версій рівняння Дрейка, яке намагається оцінити кількість активних, комунікативних позаземних цивілізацій у Чумацькому Шляху, свідчить про те, що в будь-який момент часу існує лише кілька розумних цивілізацій. Крім того, як і нас, їх відносно скромна технологічна діяльність може зробити їх невидимими для виявлення.

Читайте також: Чому позаземний розум, швидше за все, штучний

Тривожний дзвінок для людства

Це дослідження — не просто застереження про потенційну загибель. Це слугує тривожним дзвінком для людства щодо встановлення надійної нормативної бази , щоб керувати розробкою ШІ, включаючи військові системи.

Це не лише запобігання зловмисному використанню ШІ на Землі; також йдеться про те, щоб еволюція ШІ відповідала довгостроковому виживанню нашого виду.

Як зазначив історик Юваль Ной Харарі, ніщо в історії не підготувало нас до впливу появи на нашій планеті несвідомих, надрозумних істот. Нещодавно наслідки автономного прийняття рішень у сфері штучного інтелекту призвели до закликів відомих лідерів у цій галузі ввести мораторій на розробку штучного інтелекту, поки не буде запроваджено відповідальну форму контролю та регулювання.

Але навіть якщо кожна країна погодиться дотримуватись суворих правил і норм, організації-шахраї буде важко приборкати.

Інтеграція автономного штучного інтелекту в системи військової оборони повинна викликати особливе занепокоєння. Вже є докази того, що люди добровільно відмовляться від значного впливу на користь системам, які стають дедалі ефективнішими, оскільки вони можуть виконувати корисні завдання набагато швидше й ефективніше без втручання людини.

Тому уряди не бажають регулювати цю сферу, враховуючи стратегічні переваги штучного інтелекту, що нещодавно було нищівно продемонстровано в Газі .

Це означає, що ми вже небезпечно наблизилися до прірви, де автономна зброя працює за межами етичних кордонів і обходить міжнародне право.

Використання Seti як лінзи, через яку ми можемо розглядати наш майбутній розвиток, додає новий вимір дискусії про майбутнє ШІ. Ми всі повинні переконатися, що коли ми досягаємо зірок, ми робимо це не як застереження для інших цивілізацій, а як маяк надії – що ми вид, який навчився процвітати разом зі ШІ.Розмова